Riesgos de la IA en redes empresariales

Riesgos de Seguridad al utilizar IA en Redes Empresariales

Trabajar con Inteligencia Artificial puede hacernos más productivos, pero como toda tecnología nueva trae consigo un conjunto de riesgos que no siempre son evidentes para quien la integra a su operación diaria. En entornos empresariales, donde una herramienta de IA puede llegar a tener acceso a configuraciones, dispositivos críticos y datos sensibles, esos riesgos dejan de ser simple teoría y se convierten en amenazas reales con consecuencias operativas y económicas. Así que en esta clase de Riesgos de seguridad al utilizar IA en redes empresariales analicemos estos riesgos y veamos qué podemos hacer para evitarlos.

¿Qué lograrás con esta clase?

Entre algunas de las cosas que lograras en esta clase tenemos:

- Identificar los principales vectores de ataque que afectan a las herramientas de IA en entornos empresariales.

- Reconocer un ataque de prompt injection y entender por qué hoy es el riesgo número uno.

- Diferenciar entre data poisoning, bias y problemas de cadena de suministro.

- Conocer los riesgos relevantes a los niveles de privilegios de la IA.

- Definir políticas de uso, accountability y validación dentro de tu organización.

- Conocer recursos online respecto a los riesgos de la IA.

Ataques sobre la IA y sus datos

Uno de los riesgos más subestimados al trabajar con IA es la facilidad con la que un profesional puede entregar información confidencial a un tercero sin darse cuenta. En la clase analizaremos los distintos escenarios donde esta filtración ocurre, y los puntos donde la encriptación se vuelve indispensable.

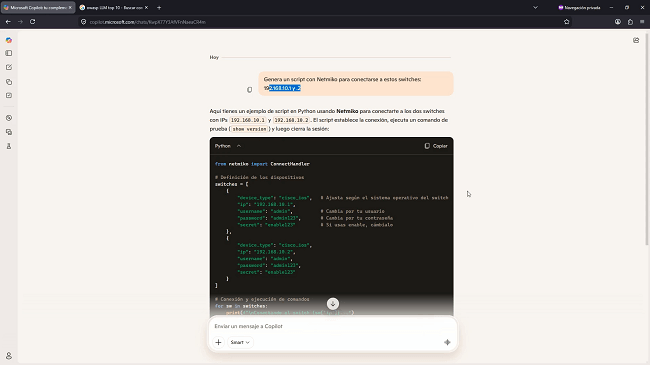

El prompt injection es hoy el riesgo más grande en aplicaciones que integran modelos de lenguaje, y existen dos formas de ejecutarlo cuyas implicaciones son diferentes. Durante la sesión demostraremos en vivo cómo se ejecuta este ataque y qué ocurre cuando una herramienta como Copilot lo detecta.

El data poisoning y el bias atacan a la IA en una etapa anterior a su uso, durante su entrenamiento, y eso los hace particularmente difíciles de detectar desde la operación. Analizaremos cómo se manifiestan en las respuestas del modelo y por qué la confianza que depositamos en una herramienta se extiende a toda su cadena de suministro.

Integración y operación responsable de la IA

Cuando una IA se conecta a los dispositivos de red para configurarlos necesita privilegios elevados, y eso la convierte en un punto crítico de seguridad. En la clase revisaremos algunas consideraciones respecto a los privilegios y por qué el control humano sigue siendo indispensable.

Los agentes de IA introducen una capa adicional de riesgo porque actúan con autonomía, y a esto se suma una característica intrínseca de los modelos actuales que no se puede eliminar por completo: las alucinaciones. Discutiremos sobre la autonomía de un agente y por qué validar cada respuesta de la IA sigue siendo necesario.

Para cerrar abordaremos el accountability, el riesgo del abuso de APIs en aplicaciones propias, y le daremos una mirada rápida al listado de OWASP Top 10.

Si planeas integrar herramientas de IA en las operaciones de tu red empresarial, accede al desarrollo completo de la clase «Riesgos de seguridad al utilizar IA en redes empresariales» y protege tu infraestructura. ¿Qué esperas? ¡Suscríbete!

❓ Preguntas Frecuentes

¿Qué es el prompt injection y por qué es el principal riesgo en aplicaciones con IA?

Es una técnica donde un atacante consigue manipular el comportamiento de una herramienta de IA disfrazando instrucciones maliciosas dentro de contenido aparentemente legítimo. Cómo se ejecuta, qué variantes existen, y qué ocurre cuando se detecta el ataque, lo vemos durante la lección.

¿Qué precauciones deben tomarse antes de integrar IA en una red empresarial?

Las precauciones se mueven en varios niveles, por ejemplo: qué información se comparte, quién es responsable de lo que hace la IA, qué privilegios se otorgan, qué validaciones humanas existen, que herramientas pueden utilizarse. Desarrollaremos estos y otros puntos en la clase.

📚 Recursos relacionados

🎓 Lecciones anteriores

📖 Lecciones siguientes

🔗 Documentación oficial

¡PARTICIPEMOS!

Si te quedaron dudas de la lección, escríbela a continuación y así todos podemos participar y ayudarte.- Este debate está vacío.

- Debes estar registrado para responder a este debate.